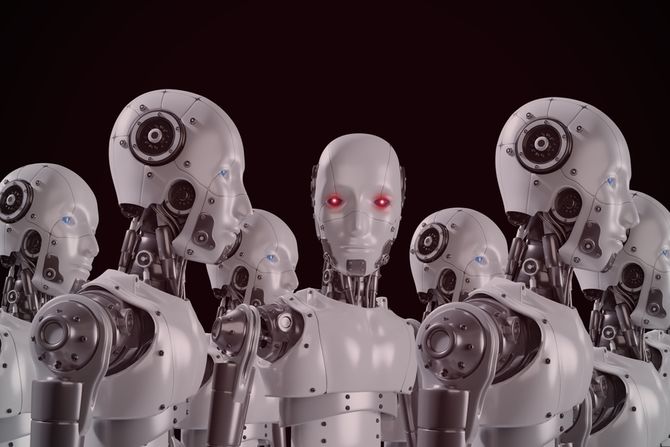

Stručnjaci iz OpenAI i Google DeepMind: Kompanije kriju opasnosti veštačke inteligencije, može nas uništiti

Grupa trenutnih i bivših zaposlenih u vodećim kompanijama za veštačku inteligenciju, OpenAI i Google DeepMind, objavila je pismo u kojem upozorava na opasnosti napredne veštačke inteligencije. Oni tvrde da kompanije stavljaju finansijski profit ispred neophodnog nadzora, čime ugrožavaju javnu sigurnost.

Pismo pod naslovom "Pravo na upozorenje o naprednoj veštačkoj inteligenciji" potpisalo je trinaest zaposlenih, od kojih je jedanaest trenutno ili ranije radilo za OpenAI, kompaniju koja stoji iza ChatGPT-a. Preostala dva potpisnika su iz Google DeepMind-a. Šest pojedinaca je odlučilo da ostane anonimno.

Koalicija upozorava da su AI sistemi dovoljno moćni da izazovu ozbiljne štete bez adekvatne regulacije. "Ovi rizici se kreću od daljeg učvršćivanja postojećih nejednakosti, preko manipulacije i dezinformacija, do gubitka kontrole nad autonomnim AI sistemima što potencijalno može rezultirati ljudskom ekstinkcijom", navodi se u pismu.

Portparolka OpenAI-a, Linzi Held, izjavila je za New York Times da je kompanija ponosna na svoj dosadašnji rad u pružanju najnaprednijih i najsigurnijih AI sistema. "Verujemo u naš naučni pristup rešavanju rizika i slažemo se da je rigorozna debata ključna, s obzirom na značaj ove tehnologije. Nastavićemo da sarađujemo sa vladama, civilnim društvom i drugim zajednicama širom sveta", dodala je Held.

Lideri tri vodeće AI kompanije — OpenAI, Google DeepMind i Anthropic — ranije su govorili o rizicima. "Ako razvijemo AI sistem koji je značajno kompetentniji od ljudskih eksperata, ali teži ciljevima koji su u sukobu sa našim najboljim interesima, posledice mogu biti katastrofalne... brzi napredak AI bi mogao biti veoma disruptivan, menjajući zapošljavanje, makroekonomiju i strukture moći", navodi se u izjavi kompanije Anthropic iz marta 2023. godine.

Grupa koja stoji iza pisma tvrdi da AI kompanije poseduju informacije o rizicima svojih tehnologija, ali zbog nedostatka regulative te informacije ostaju skrivene. "Obični zakoni o zaštiti uzbunjivača su nedovoljni jer se fokusiraju na ilegalne aktivnosti, dok su mnogi rizici koje nas brinu još uvek neregulisani," piše u pismu.

Advokat grupe, Lorens Lesig, rekao je za New York Times da su zaposleni važna linija odbrane za bezbednost i da, "ako ne mogu slobodno da govore bez odmazde, taj kanal će biti zatvoren."

Prema istraživanju Instituta za AI politiku, 83% Amerikanaca veruje da AI može slučajno dovesti do katastrofalnog događaja, a 82% ne veruje tehnološkim izvršnim direktorima da će sami regulisati industriju.

Pismo sadrži četiri zahteva za AI kompanije: prestanak primoravanja zaposlenih na ugovore koji ih sprečavaju da kritikuju poslodavce zbog rizika, stvaranje anonimnog procesa za prijavljivanje zabrinutosti, podršku kulturi otvorene kritike i neodmazdu prema bivšim i trenutnim zaposlenima koji dele poverljive informacije o rizicima nakon što drugi procesi nisu uspeli.

(Telegraf.rs)

Video: Vlahović: Bila je dobra provera za nas, ali naravno da nismo zadovoljni

Telegraf.rs zadržava sva prava nad sadržajem. Za preuzimanje sadržaja pogledajte uputstva na stranici Uslovi korišćenja.